보안 카메라 하드웨어 및 이미징 광학 분야의 한 세기의 진화

기계적 선사시대: 운동 기록부터 폐쇄 회로 프로토타입까지

보안 카메라의 기술적 궤적은 하루아침에 성공한 것이 아니라 200년에 걸쳐 학제간 발전을 이룬 것입니다. 그 뿌리는 연속적이고 역동적인 이미지를 포착하려는 최초의 시도와 함께 19세기 후반으로 거슬러 올라갑니다. 1870년에 영국의 발명가 Wordsworth Donisthorpe는 움직임을 포착하기 위해 설정된 간격으로 일련의 사진을 찍도록 설계된 동영상 카메라인 "kinesigraph"에 대한 특허를 받았습니다.11889년에 Donisthorpe와 Louis Le Prince는 필름 카메라와 프로젝션 기술을 더욱 발전시켰습니다. Le Prince는 16렌즈 카메라도 개발했는데, 이는 당시에는 실험적인 도구에 가까웠지만 특정 공간에서 지속적인 모니터링을 위한 물리적 기반을 마련했습니다.1

최초의 진정한 폐쇄회로 텔레비전(CCTV) 시스템은 제2차 세계대전 중 군사적 필요로 인해 탄생했습니다. 1942년 독일 엔지니어 Walter Bruch는 안전한 벙커에서 A4(V-2) 로켓 발사를 모니터링하는 시스템을 설계하고 감독하는 임무를 맡았습니다.1이 시스템의 핵심은 "폐쇄 회로" 특성이었습니다. 즉, 비디오 신호는 미리 설정된 비공개 모니터로만 전송되었습니다. 당시의 이미징 기술은 녹음 수단 없이 부피가 큰 진공관과 복잡한 아날로그 회로에 전적으로 의존했습니다. 이미지가 사라지면 정보가 영원히 사라지기 때문에 보안 담당자는 모니터를 실시간으로 지켜봐야 했습니다.2

1949년 미국 회사인 Vericon은 최초의 상업용 CCTV 시스템을 출시하여 군사 부문에서 상업 및 민간 부문으로의 전환을 알렸습니다.3이러한 초기 상용 시스템은 주로 동축 케이블을 통해 연결된 고정 흑백 카메라를 사용했습니다. 진공관의 높은 열, 높은 전력 소비 및 110V AC 요구 사항으로 인해 설치가 엄격히 제한되었으며, 종종 카메라가 전원 콘센트에서 6피트 이내에 있어야 했습니다.5더욱이 광학 성능은 해상도가 약 240라인에 불과하여 극도로 제한되었습니다.

진공관의 정점과 위험: Vidicons 대 Plumbicons

반도체 이미징 기술이 성숙하기 전에는 진공관(Pick-up Tube)이 보안카메라의 유일한 핵심이었습니다. 이들 장치는 기본적으로 역방향으로 작동하는 음극선관(CRT)이었습니다. 1950년대 RCA의 Weimer, Forgue, Goodrich는 감광성 반도체(처음에는 삼황화안티몬)를 타겟으로 사용하는 저장형 카메라 튜브인 Vidicon을 개발했습니다.7

물리적 메커니즘 및 재료 제한

카메라 튜브의 작동 원리는 광학 렌즈를 통해 감광성 대상에 장면의 초점을 맞춘 다음 전자총에서 나오는 저속 전자빔으로 스캔하는 것입니다. 빛이 목표물에 닿으면 국부 전도도가 변하여 전자빔 전류가 변동하고 빛이 비디오 신호로 변환됩니다.8비디콘은 카메라 크기와 비용을 대폭 줄여 비방송 감시의 표준이 되었습니다.7

그러나 Vidicon은 치명적인 "소진(burn-out)" 결함을 겪었습니다. 태양, 반사율이 높은 표면 또는 밝은 빛 지점을 너무 오랫동안 비추면 감광성 대상이 영구적인 물리적 손상을 입어 "사각지대"가 생성됩니다.8또한 Vidicons는 큰 소음이나 폭발로 인해 박막 대상에 물리적 진동이 발생하여 화면에 수평 막대가 나타나는 "마이크 효과"에 취약했습니다.8

비디콘의 낮은 감도와 심각한 "트레일링"(혜성 꼬리)을 극복하기 위해 Philips는 1960년대에 Plumbicon을 출시했습니다. 산화납을 타겟으로 사용하는 Plumbicon은 높은 신호 대 잡음비와 극히 낮은 이미지 지연을 제공했습니다.7방송에는 성공했지만 높은 비용으로 인해 고급 애플리케이션에 대한 보안 사용이 제한되었습니다. Tivicon(실리콘 다이오드 튜브) 및 Newvicon(Panasonic에서 생산)과 같은 저조도 기술이 발전한 1970년대 후반이 되어서야 진공관이 야간 모니터링의 기본 요구 사항을 충족했습니다.10

아래 표에는 초기 진공관 보안 카메라의 발전 과정이 요약되어 있습니다.

| 기술 단계 | 코어 센서 | 대표연도 | TV 라인 | 주요 특징 | 제한 사항 |

| 개시 | 초기 광전 튜브 | 1942 | 100-200 | 군용, 실시간 관측 |

용량이 너무 커서 녹음이 안 됨4 |

| 상용화 | 비디콘 | 1950년대 | 240 | 간단한 구조, 비용 절감 |

번아웃되기 쉽고 감도가 낮음7 |

| 성능 향상 | 플럼비콘 | 1960년대 | 400+ | 높은 SNR, 낮은 지연 |

매우 비싸다8 |

| 아날로그 피크 | 뉴비콘/사티콘 | 1970년대 | 480-700 | 초기 저조도 기능 |

여전히 크며 AC 전원에 따라 다름10 |

실리콘의 노벨상: CCD의 탄생과 통치

1969년은 현대 영상 역사에 있어서 획기적인 사건이었습니다. 벨 연구소의 윌라드 보일(Willard Boyle)과 조지 스미스(George Smith)는 전하결합소자(CCD)를 발명했는데, 이 업적은 나중에 노벨 물리학상을 수상했습니다.13CCD는 깨지기 쉬운 진공관을 고체 실리콘 칩으로 대체하여 보안 카메라 하드웨어에 혁명을 일으켰습니다.13

전하 결합 기술: 물통 비유

CCD의 작동 원리는 "빗물을 모으는 양동이 배열"에 비유될 수 있습니다. 센서의 각 픽셀(실리콘 원자)은 광자(빗방울)를 수집하는 양동이처럼 작동합니다. 광전 효과는 광자를 광전자로 변환하여 전위 우물에 저장됩니다. 판독 단계에서 이러한 전하는 릴레이 경주처럼 행 단위로 판독 증폭기로 이동하여 전압으로 변환됩니다.13CCD의 장점은 높은 이미지 균일성과 낮은 패턴 노이즈에 있습니다. 모든 픽셀은 일반적으로 1~4개의 판독 증폭기를 공유하여 일관성을 보장합니다.13

Fairchild Semiconductor는 1973년에 해상도가 100x100 픽셀에 불과한 세계 최초의 상업용 CCD인 MV-100을 출시했습니다.14처음에는 산업 및 군사용으로 의도되었지만 "주머니 크기" 보안 카메라의 길을 열었습니다.16소니는 1970년대 내내 R&D에 무려 200억엔을 투자했고, 결국 1980년에 XC-1 컬러 CCD 카메라를 상용화했습니다.18당시 자살행위로 간주되었던 이러한 움직임은 Sony를 수십 년 동안 글로벌 이미지 센서 시장의 지배적인 세력으로 자리매김하게 했습니다.19

아날로그 모니터링과 PCB 진화의 황금시대

1980년대와 1990년대 CCD 통치 기간 동안 내부 카메라 전자 장치 역시 급격한 변화를 겪었습니다. 인쇄 회로 기판(PCB) 기술은 페놀 종이에서 유리 섬유 기판으로 이동하여 열 안정성과 신호 무결성을 크게 향상시켰습니다.61970년대에는 PCB가 단면 배선만 지원했습니다. 1980년대에는 양면 PCB를 통해 더 많은 신호 처리 구성 요소(예: 초기 비디오 프로세서)를 소형 카메라 하우징에 통합할 수 있었습니다.6이 기간 동안 보안 시스템은 동축 케이블을 사용하여 아날로그 신호를 전송했으며 해상도는 아날로그 기술의 물리적 한계인 약 700TV 라인(TVL)에 도달했습니다.5

CMOS APS와 디지털 혁명: "캡처"에서 "컴퓨팅"까지

CCD는 오랫동안 이미지 품질을 주도했지만 복잡한 제조, 높은 전력 소비, 논리 회로 통합 불가능으로 인해 카메라 지능이 제한되었습니다. 1990년대 중반, CMOS APS(Complementary Metal-Oxide-Semiconductor Active Pixel Sensor) 기술이 성숙되기 시작했습니다.13

아키텍처 전쟁: CMOS 대 CCD

CCD의 "직렬 판독"과 달리 CMOS 센서의 각 픽셀에는 자체 증폭기와 판독 회로가 있습니다. 이 아키텍처는 다음과 같은 여러 기술적 이점을 제공합니다.

-

높은 통합:ISP(이미지 신호 프로세서), ADC(아날로그-디지털 변환기) 및 타이밍 제어 회로를 동일한 실리콘 다이에 통합하여 SoC(시스템 온 칩)를 형성할 수 있습니다.21

-

초고속:수천 개의 판독 채널을 통해 CMOS 속도는 CCD보다 100배 더 빠르므로 높은 프레임 속도 모니터링(60fps 이상)과 슬로우 모션 재생이 가능합니다.13

-

전력 제어:CMOS는 픽셀 전환 중에만 상당한 전력을 소비하므로 열을 대폭 줄여 연중무휴 보안 운영에 중요한 요소입니다.13

2007년에 CMOS는 CCD와 동등한 시장 수준에 이르렀고, 2019년에는 BSI(Back-Illuminated) 기술의 인기로 인해 CMOS 성능이 CCD를 능가했습니다.13BSI는 센서 레이어를 재정렬하여 빛이 회로 레이어보다 먼저 포토다이오드에 닿도록 함으로써 양자 효율(QE)을 대폭 높이고 "스타라이트" 감시를 위한 기반을 마련합니다.14

아래 표에서는 최신 보안 애플리케이션의 CCD와 CMOS를 비교합니다.

| 매개변수 | CCD 센서 | CMOS 센서(APS) | 추세에 미치는 영향 |

| 판독 속도 | 1~40MPS | 100 - 400+ MPS |

HD 비디오 스트리밍 활성화13 |

| 소음 읽기 | 5 - 10개의 전자 | 1 - 3 전자 |

저조도 선명도 향상13 |

| 다이내믹 레인지 | 높음(풀프레임) | 매우 높음(HDR) |

WDR 혁신 촉진15 |

| 비용 | 높음(특수 라인) | 낮음(표준 CMOS) |

카메라 민주화를 주도하다13 |

| 완성 | 낮음(외부 칩) | 높음(단일 칩 SoC) |

Edge AI 카메라로 이어짐22 |

광학 렌즈의 진화: 고정 유리에서 지능형 시스템으로

센서가 카메라의 "망막"이라면 렌즈는 "수정 렌즈"입니다. 보안 측면에서 렌즈는 매우 다양한 환경에서도 해상력을 유지해야 합니다.

수차 극복: 비구면 요소의 부상

초기 모니터링 렌즈는 대부분 구형이었습니다. 구면 렌즈의 물리적 특성으로 인해 가장자리와 중앙의 광선이 동일한 지점에 수렴되지 않아 구면 수차와 가장자리 흐림이 발생합니다.26이를 해결하기 위해 보안렌즈는 비구면 요소를 대량 채용하기 시작했습니다. 이 이론은 1637년 데카르트에 의해 제안되었지만 1980년대가 되어서야 정밀 유리 성형을 통해 대량 생산이 가능해졌고 선명도를 유지하면서 더 큰 조리개(F/1.4 또는 F/1.0)가 가능해졌습니다.27

줌 및 자동 백 포커스 보정

1970년대에는 유연한 시야각에 대한 요구로 인해 줌 렌즈가 탄생했습니다. 그러나 기존 줌 렌즈는 초점 거리가 변경되는 동안 초점을 잃는 경우가 많습니다. 명확성을 보장하기 위해 업계에서는 광각에서 망원까지 센서 면에 초점을 고정하는 "백 포커스 조정" 메커니즘을 개발했습니다.29최신 전동 줌 렌즈에는 정밀 스테퍼 모터가 통합되어 알람 트리거에 따라 시야를 자동으로 조정합니다.26

P-iris: HD 시대의 회절 딜레마 해결

센서 해상도가 0.3MP에서 8MP(4K)로 향상되면서 기존 자동 조리개 렌즈의 단점이 드러났습니다. 기존 DC-아이리스는 밝기에 따라 개구부 크기만 조정합니다. 밝은 환경에서는 홍채가 너무 촘촘하게 닫혀 심각한 회절을 유발하고 이미지가 흐려지는 현상을 "광학 한계"라고 합니다.30

이에 대응하기 위해 Axis Communications는 P-iris(Precise Iris) 기술을 도입했습니다. P-iris는 광 센서에만 의존하지 않습니다. 소프트웨어를 사용하여 렌즈의 스테퍼 모터와 통신합니다.

-

최적의 조리개 선택:소프트웨어는 렌즈의 "최적 지점"(보통 중간 범위 F-스톱)을 식별하고 이를 최대한 유지합니다.30

-

이득 및 노출 연결:빛이 너무 강하면 시스템은 조리개를 과도하게 닫는 대신 노출 단축이나 전자 이득 감소를 우선시하여 회절을 방지합니다.30

-

최대화된 피사계 심도:긴 복도와 같은 장면의 경우 P-iris는 피사계 심도를 최적화하여 전경과 배경이 모두 선명하게 유지되도록 합니다.33

ISP 발전: 디지털 시신경의 부상

센서의 원시 데이터를 보려면 ISP(이미지 신호 프로세서)에서 처리해야 합니다. ISP의 진화는 보안 모니터링을 '보는 것'에서 '명확하고 정확하게 보는 것'으로 바꾸어 놓은 것입니다.

WDR(Wide Dynamic Range)에 대한 기술 경로

역광 장면(예: 은행 창구)에서는 밝은 영역과 어두운 영역의 차이가 100,000배를 초과할 수 있습니다. ISP는 세 가지 주요 방법을 통해 이를 처리합니다.

-

디지털 WDR(DWDR):감마 곡선을 조정하여 어두운 영역을 밝게 하는 소프트웨어 알고리즘입니다. 가격은 저렴하지만 소음이 크다.35

-

진정한 WDR(다중 노출 퓨전):주류 하이엔드 솔루션. ISP는 센서에 짧은 노출(강조 표시)과 긴 노출(그림자)의 두 프레임을 빠르게 연속해서 촬영하도록 지시합니다. 그러면 픽셀 수준 등록이 원활하게 융합됩니다.36

-

포렌식 WDR:모션 아티팩트를 줄이기 위해 최적화된 버전으로, 움직이는 물체에 번호판 인식에 중요한 "고스팅"이 발생하지 않도록 합니다.25

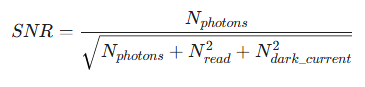

ISP 알고리즘의 신호 대 잡음비(SNR)는 다음과 같이 설명할 수 있습니다.

극저조도 혁신: Starlight 및 Blacklight

보안의 마지막 경계는 어둠입니다. 기존 IR 야간 투시경은 색상이 손실되어 의복이나 차량 색상을 식별하는 것이 불가능합니다.40

"Starlight" 카메라의 세 가지 하드웨어 기둥

Starlight의 성공은 물리적 한계를 뛰어넘는 데 달려 있습니다.

-

대형 센서:1/1.8인치 또는 1/1.2인치 센서를 사용합니다. 이는 픽셀당 수광 영역을 증가시켜 더 많은 광자를 포착합니다.39

-

초대형 조리개 광학:F/1.0 또는 F/0.95 렌즈가 장착되어 표준 F/2.0 렌즈보다 4배 더 많은 광량을 흡수합니다.26

-

슬로우 셔터 알고리즘:통합 시간을 늘리기 위해 ISP에 프레임을 스태킹합니다. 이로 인해 일부 모션 블러가 발생하지만 0.001 Lux 환경에서 낮과 같은 컬러 이미지를 생성합니다.24

Blacklight(DarkFighter X) 듀얼 센서 융합

빛이 0.0001 Lux 아래로 떨어지면 이득만으로는 충분하지 않습니다. Hikvision(DarkFighter X) 및 Keda와 같은 제조업체는 인간 눈의 간상체와 원뿔을 모방하는 Blacklight 기술을 출시했습니다.

-

광학 분할:특수 프리즘은 빛을 적외선과 가시광선으로 분리합니다.44

-

듀얼 센서:한 센서는 IR(휘도 및 디테일)을 캡처하고 다른 센서는 약한 가시광선(색상)을 캡처합니다.

-

픽셀 수준 융합:ISP는 실시간으로 두 경로를 맞춰 밝은 풀 컬러, 저잡음 비디오를 출력합니다. 이를 위해서는 하위 픽셀 보정 정확도가 필요합니다.44

다중 렌즈 시너지 효과 및 컴퓨터 이미징: 새로운 시대

현대의 모니터링은 단일 관점을 넘어 다중 센서 융합 플랫폼으로 나아가고 있습니다.

파노라마 접합(PanoVu) 및 이중 렌즈 연결(TandemVu)

광장이나 공항과 같은 넓은 지역을 커버하기 위해 Hikvision의 PanoVu 시리즈는 4~8개의 센서를 통합합니다. ISP 알고리즘은 다음을 포함하는 "원활한 스티칭"을 수행합니다.

-

노출 일관성:모든 센서에서 밝기가 균일하도록 보장합니다.45

-

픽셀 등록:이음새의 사각지대와 고스트 현상을 제거합니다.45

-

다방향 모니터링:하나의 IP 주소와 하나의 케이블로 360도 뷰를 관리할 수 있어 시스템 비용이 절감됩니다.47

컴퓨터 사진 및 스마트 조명

컴퓨팅 이미징은 하드웨어와 소프트웨어 사이의 경계를 모호하게 만들고 있습니다.

-

스마트 하이브리드 라이트:Hikvision의 Smart Hybrid Light와 같은 카메라는 AI를 사용하여 사람이나 차량이 감지되면 눈에 띄지 않는 IR 모드에서 백색광 색상 모드로 전환합니다.41

-

다중 스펙트럼 융합:열 융합(LWIR) 및 가시광선. 열화상은 열(숨겨진 목표물)을 감지하고, 가시적 기능은 이를 식별하여 주변 보호 정확도를 크게 향상시킵니다.51

2030 비전: 보안 하드웨어의 파괴적인 미래

2030년을 바라보면 보안카메라의 형태는 또 다른 질적 변화를 겪게 될 것이다.

무렌즈 이미징 및 양자 센서

연구에 따르면 계산 광학을 기반으로 한 "렌즈 없는 카메라"가 성숙해지고 있는 것으로 나타났습니다. 유리 렌즈 대신 얇은 광학 인코더를 사용하면 카메라를 스티커처럼 얇게 만들 수 있습니다.20또한 SPAD(단일 광자 눈사태 다이오드)를 사용하면 광자 계산(광자 계산) 조건에서 이미징이 가능합니다.20

감정과 의도 인식

2030년까지 카메라는 단순한 시각적 도구가 아닙니다.

-

생체인식 모니터링:장거리 레이저 도플러 진동계를 사용하여 심장 박동과 호흡을 포착합니다.55

-

감정 분석:심층 신경망은 미세한 표현과 신체 언어를 분석하여 범죄가 발생하기 전에 "의도 예측"을 수행합니다.55

-

엣지 자율성:5G/6G 및 저전력 AI 칩을 사용하면 카메라가 '디지털 경비원' 역할을 하여 모든 분석을 로컬에서 수행하고 양자 프로토콜을 통해 암호화된 데이터를 업로드합니다.3

결론: 빛과 그림자로 요약된 세기

감시 카메라의 진화는 인류가 끊임없이 '가시성'을 추구해온 역사입니다. 1942년 벙커 머신부터 픽셀 수준 융합과 컬러 나이트 비전을 갖춘 오늘날의 AI 기반 터미널에 이르기까지 모든 단계가 물리적 한계를 뛰어넘었습니다. 렌즈는 구형에서 비구면으로, 홍채는 수동 홍채에서 P-홍채로 이동했습니다. 센서는 부피가 큰 튜브에서 BSI CMOS로, 그리고 양자 감지로 이동했습니다. PCB 기술은 단순한 연결에서 고성능 SoC 플랫폼으로 이동했습니다.

보안의 미래는 차가운 하드웨어의 집합이 아니라 물리학, 반도체, AI의 융합이 될 것입니다. 사회를 보호하는 동시에 향후 10년간의 진정한 과제는 기술 진보와 개인 정보 보호 윤리 간의 균형을 찾는 것입니다.